6 Assunções da Regressão Linear

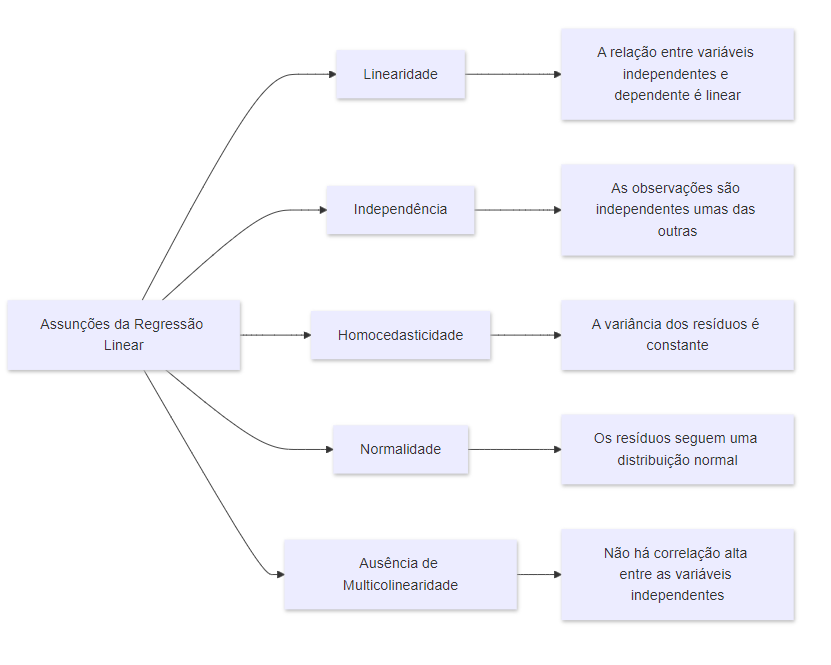

A regressão linear baseia-se em várias suposições fundamentais que garantem a validade e a eficácia dos modelos. Quando essas suposições são violadas, os resultados do modelo podem ser enganosos ou imprecisos. A figura 6.1 apresenta as 5 assunções.

6.1 Linearidade

A primeira suposição da regressão linear é que existe uma relação linear entre as variáveis independentes e a variável dependente. Isso significa que a mudança na variável dependente é proporcional às mudanças nas variáveis independentes. Graficamente, isso se traduz em uma linha reta quando plotamos a variável dependente contra uma variável independente.

O modelo de regressão linear busca encontrar a melhor linha reta que se ajusta aos dados. Se a relação verdadeira não for linear, o modelo pode não capturar adequadamente o padrão nos dados.

Podemos verificar esta assunção por gráficos de dispersão entre cada variável independente e a variável dependente. Se a relação for linear, veremos um padrão aproximadamente linear nesses gráficos.

Se a relação real for não-linear (por exemplo, quadrática ou exponencial), um modelo linear não será capaz de capturar adequadamente essa relação. Isso pode levar a previsões imprecisas e interpretações errôneas dos coeficientes do modelo.

Se a relação não for linear, podemos considerar transformações nas variáveis (como logaritmo ou raiz quadrada) ou utilizar modelos mais flexíveis, como regressão polinomial ou outros modelos não-lineares.

Verificação de Linearidade

Pode-se usar gráficos de dispersão para verificar visualmente a linearidade. A relação linear é observada quando os dados seguem um padrão reto, sem curvaturas.

Impacto da Violação

Se a relação não for linear, o modelo de regressão pode subestimar ou superestimar os valores previstos. Técnicas de transformação de dados ou o uso de modelos não lineares podem ser alternativas quando a linearidade não é atendida.

Exemplo

Imagine que estamos modelando o preço de casas (variável dependente) com base no tamanho da casa em metros quadrados (variável independente). A assunção de linearidade sugere que cada metro quadrado adicional aumentaria o preço da casa por um valor constante, o que nem sempre é verdade no mundo real. Em muitos casos do mundo real, as relações raramente são perfeitamente lineares. O que buscamos é uma aproximação razoável da linearidade que seja útil para nossos propósitos de modelagem.

6.2 Independência

A suposição de independência requer que as observações sejam independentes umas das outras. Em outras palavras, o erro associado a uma observação não deve influenciar o erro de outra observação.

Em termos estatísticos, isso significa que os erros (resíduos) para diferentes observações devem ser não correlacionados entre si.

Esta assunção é fundamental porque muitos dos procedimentos estatísticos usados na regressão linear (como testes de significância e intervalos de confiança) dependem da independência das observações para serem válidos.

Existem contextos em que a independência é comum, por exemplo, em uma mostragem aleatória simples de uma população; em experimentos controlados onde as unidades experimentais são atribuídas aleatoriamente aos tratamentos

Também existem contextos em que a independência pode ser violada, por exemplo, em dados de séries temporais (onde observações próximas no tempo podem estar relacionadas); em dados espaciais (onde observações próximas geograficamente podem estar relacionadas); em medidas repetidas no mesmo indivíduo; e em dados agrupados ou hierárquicos (como alunos dentro de escolas)

Quando a assunção de independência é violada, o que acontece é que, os erros padrão dos coeficientes podem ser subestimados; os intervalos de confiança podem ser muito estreitos; além disso, os testes de hipóteses podem ter taxas de erro Tipo I inflacionadas (ou seja, rejeitar a hipótese nula quando ela é verdadeira com mais frequência do que o nível de significância sugere)

Para detecção de violações podemos utilizar gráfico de resíduos x ordem das observações (para dados temporais); também podemos utilizar testes estatísticos como o teste de Durbin-Watson (para autocorrelação em séries temporais), além disso, podemos utilizar a análise de autocorrelação e autocorrelação parcial.

Para solucionar as violações, podemos, por exemplo, para dados de séries temporais usar modelos de séries temporais como ARIMA; se os dados forem espaciais podemos usar modelos de regressão espacial; já para medidas repetidas ou dados agrupados podemos usar modelos mistos, ou hierárquicos

Entender a assunção de independência é importante não apenas para a análise, mas também para o design de estudos. Isso pode influenciar como coletamos dados e estruturamos nossas análises.

A assunção de independência é frequentemente uma das mais desafiadoras de satisfazer completamente em situações do mundo real. No entanto, entender suas implicações e saber como lidar com violações é fundamental para realizar análises estatísticas robustas e confiáveis.

Verificação de Independência

A independência pode ser avaliada através do teste de Durbin-Watson, que verifica a presença de autocorrelação nos resíduos do modelo.

Impacto da Violação

A violação da independência, especialmente em dados de séries temporais, pode levar a inferências enganosas. Modelos específicos, como a Regressão Linear Autoregressiva (AR), podem ser usados para lidar com autocorrelação.

Exemplo

Imagine que estamos analisando o desempenho de estudantes em um teste. Se coletarmos dados de vários alunos de diferentes escolas, poderíamos violar a assunção de independência, pois alunos da mesma escola provavelmente têm desempenhos mais semelhantes entre si do que com alunos de outras escolas.

6.3 Homocedasticidade

A homocedasticidade assume que a variância dos erros é constante para todos os valores das variáveis independentes. Em um modelo de regressão linear ideal, os resíduos devem ter uma variância constante ao longo de todos os níveis das variáveis preditoras.

Verificação de Homocedasticidade

Gráficos de resíduos vs. valores ajustados são usados para verificar homocedasticidade. A variância constante é evidenciada por uma distribuição uniforme dos resíduos em torno do eixo horizontal.

Impacto da Violação

A heterocedasticidade, ou variância não constante, pode afetar a confiabilidade das inferências estatísticas e a precisão dos intervalos de confiança. Métodos como transformação de dados ou regressão ponderada podem corrigir essa violação.

6.4 Normalidade

A suposição de normalidade refere-se à distribuição normal dos erros. Para que as inferências baseadas no modelo de regressão sejam válidas, os resíduos devem seguir uma distribuição normal.

Verificação de Normalidade

Histogramas e gráficos de probabilidade normal (Q-Q plots) são frequentemente usados para avaliar a normalidade dos resíduos.

Impacto da Violação

A falta de normalidade pode afetar a precisão dos testes de hipótese e dos intervalos de confiança. Transformações de dados, como logaritmos ou raízes quadradas, podem ser utilizadas para normalizar os resíduos.

6.5 Multicolinearidade

A multicolinearidade ocorre quando duas ou mais variáveis independentes estão altamente correlacionadas entre si, o que pode dificultar a determinação do efeito isolado de cada variável sobre a variável dependente.

6.5.1 Verificação de Multicolinearidade

O fator de inflação da variância (VIF) é uma medida comum usada para detectar multicolinearidade. VIFs superiores a 10 indicam problemas significativos de multicolinearidade.

6.5.2 Impacto da Violação

A multicolinearidade pode tornar os coeficientes de regressão instáveis e difíceis de interpretar. A remoção de variáveis correlacionadas ou a aplicação de técnicas de regularização, como Lasso ou Ridge, pode ajudar a mitigar esse problema.

6.6 Exercícios

Qual das seguintes opções é uma suposição básica da regressão linear em relação aos resíduos?

Os resíduos devem aumentar linearmente com o aumento das variáveis independentes.

Os resíduos devem ter uma variância não constante.

Os resíduos devem seguir uma distribuição normal com média zero.

Os resíduos devem ser dependentes uns dos outros.

O que é homocedasticidade na regressão linear?

A presença de multicolinearidade entre variáveis independentes.

A condição em que a variância dos resíduos é constante em todos os níveis das variáveis independentes.

A normalidade dos resíduos.

A correlação entre os resíduos.

Quando a suposição de linearidade pode ser violada em um modelo de regressão linear?

Quando a relação entre as variáveis dependente e independente é não linear.

Quando os resíduos seguem uma distribuição normal.

Quando as variáveis independentes são altamente correlacionadas.

Quando a amostra de dados é muito pequena.

O que é multicolinearidade na regressão linear?

Uma técnica para reduzir a variância dos resíduos.

A suposição de que a relação entre as variáveis dependente e independente é linear.

A situação em que duas ou mais variáveis independentes estão altamente correlacionadas entre si.

A condição em que os resíduos não são normalmente distribuídos.

Como a violação da suposição de independência dos resíduos pode afetar um modelo de regressão linear?

Pode levar a inferências enganosas devido à presença de autocorrelação nos resíduos.

Pode aumentar a precisão dos coeficientes de regressão.

Pode melhorar a capacidade do modelo de prever novos dados.

Pode tornar o modelo mais robusto a outliers.